Rozprzestrzeniane m.in. w Internecie, zwłaszcza w mediach społecznościowych, fałszywe treści tego typu stają się coraz bardziej niebezpieczne. Mogą być narzędziem cyberprzestępstw, a także politycznych i społecznych manipulacji. Naukowcy Politechniki Krakowskiej do walki z deepfake’ami chcą użyć ich … własnej broni – nowoczesnych technik opartych na sieciach neuronowych i metodach uczenia głębokiego. Krakowski zespół otrzymał na ten cel dofinansowanie w wysokości 4 milionów złotych.

Reklama

.

Na Politechnice Krakowskiej trwają prace nad wykrywaczem tzw. deepfake’ów w treściach wideo, audio i obrazach.

Deepfake – co to jest?

Zjawisko deepfake jest stosunkowo nowe – datowane na rok 2017, gdy użytkownik internetowego forum Reddit o nazwie “deepfakes” zapoczątkował niechlubny trend udostępniania filmów pornograficznych, w których zamiast twarzy aktorek umieszczano twarze znanych celebrytek. Do osiągnięcia tego efektu użyte zostały nowoczesne techniki oparte na sieciach neuronowych i metodach uczenia głębokiego.

Już wcześniej, po zaproponowaniu w roku 2014 sieci GAN (Generative Adversarial Networks) czyli modeli będących w stanie generować nowe obrazy, pojawiły się niesamowite możliwości zastosowań sieci neuronowych w wirtualnych manipulacjach treściami. Sztandarowym przykładem była możliwość preparowania zdjęć ludzi, którzy nigdy nie istnieli (łatwy dostęp do serwisu z takimi zdjęciami, ułatwia np. tworzenie fałszywych kont w serwisach społecznościowych).

Obecnie najczęściej jako deepfake rozumie się jakąkolwiek nieprawdziwą informację, która rozprzestrzenia się wirusowo zazwyczaj poprzez media społecznościowe bądź kanały medialne niezbyt dbające o weryfikację źródeł dystrybuowanych przez siebie informacji.

W bardziej wąskim i specjalistycznym znaczeniu, termin ten opisuje zawartość medialną, zazwyczaj video lub audio, która wygenerowana została z wykorzystaniem metod obliczeniowych sztucznej inteligencji (SI), nowoczesnych metod uczenia głębokiego. Nazwa deepfake wzięła się z połączenia „deep learning” (ang. głębokie uczenie) oraz „fake”(fałszywy).

Zmanipulowane treści zagrożeniem dla demokracji

– Zmanipulowane fałszywe informacje coraz częsciej są wykorzystwane do nieczystej gry politycznej, a nawet zakłócania procesu wyborczego w krajach demokratycznych – mówi kierujący zespołem prof. Michał Bereta.

Reklama

.

W skali światowej pojawiają się pierwsze próby oferowania usług weryfikacji treści, ale - m.in. ze względów bezpieczeństwa pracujące nad nimi firmy - nie upubliczniają szczegółów implementacyjnych swoich modeli detekcyjnych.

- Produkty tego typu jak wykrywacz, nad którym pracujemy w Krakowie, pozostają często w zasobach państw, w których powstają – podkreśla ekspert Politechniki. – W naszym rozwiązaniu zaproponujemy unikatowe techniki obliczeniowe, na rynku polskim nie są znane jeszcze rozwiązania odpowiadające naszemu funkcjonalnością i dostępnością.

Naukowa broń do detekcji

W projekcie planowany jest rozwój metod wykrywania materiałów deepfake, zarówno w postaci pojedynczych obrazów, jak i nagrań wideo. Wykorzystane w tym celu zostaną różne metody uczenia maszynowego, nie tylko sztuczne sieci neuronowe.

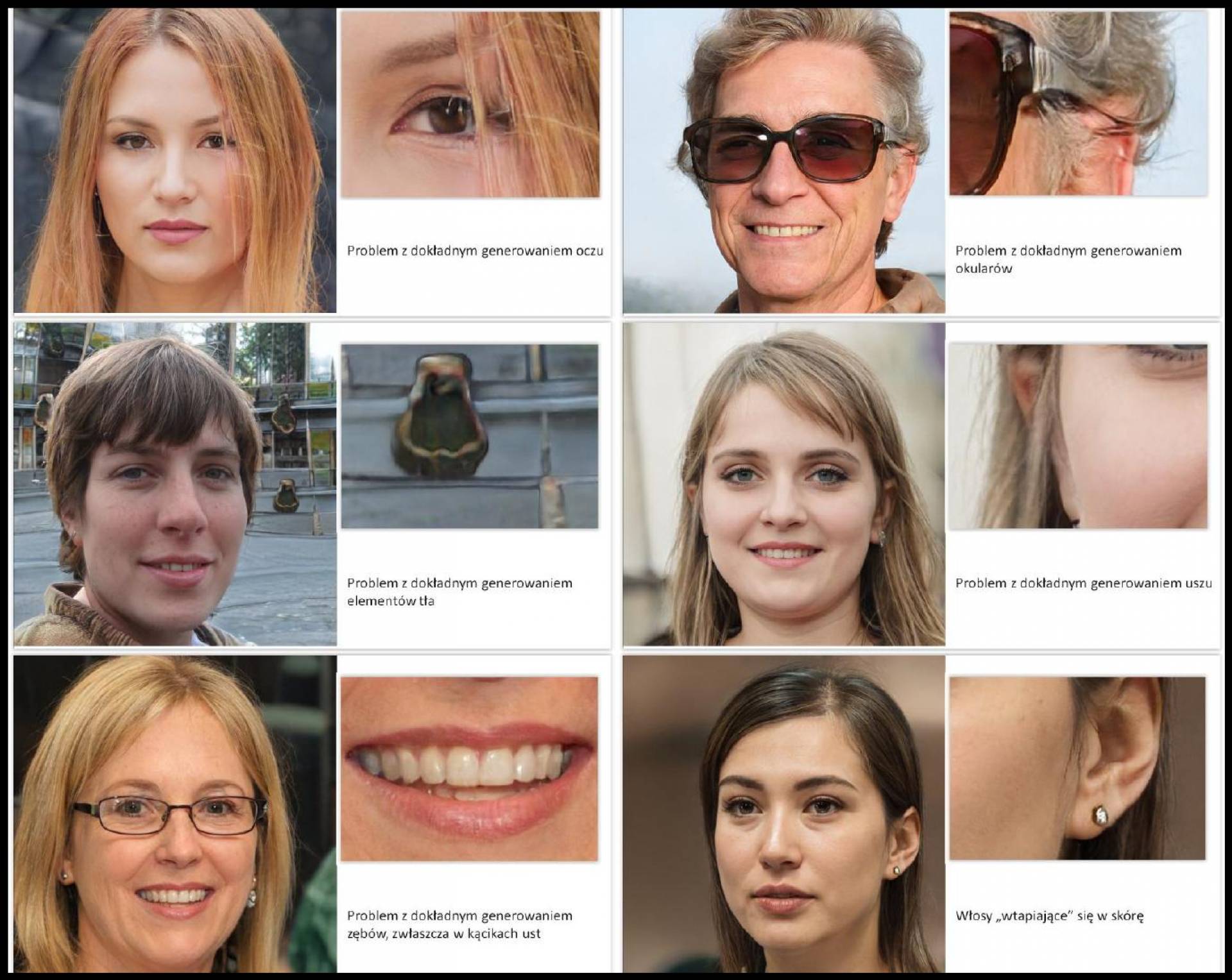

Planowane jest również wykorzystanie algorytmów wykrywania anomalii, jak również wykorzystanie ewolucyjnych algorytmów w celu optymalizacji lokalnych deskryptorów obrazów, tak by opracowane w ten sposób deskryptory były bardziej skuteczne w wykrywaniu charakterystycznych błędów i niedociągnięć metod generowania materiałów deepfake.

Internetowy wyścig zbrojeń

Naukowcy Politechniki Krakowskiej prognozują, że podobnie jak pomiędzy twórcami wirusów komputerowych oraz autorami programów antywirusowych trwa nieustający wyścig zbrojeń, tak podobna sytuacja będzie miała miejsca pomiędzy twórcami materiałów deepfake a badaczami SI, którzy będą się starali opracować jak najlepsze metod ich wykrywania.

Reklama

.

- Pojawienie się głośnych medialnie przypadków prób groźnego wykorzystania fałszywych materiałów w celu walki politycznej, zniesławienia bądź oszustwa czyni nasz projekt jeszcze bardziej pożądanym rynkowo – uważa prof. Michał Bereta.

Prace nad projektem pt. „Detekcja zmanipulowanych treści audio-wideo w celu ochrony przed rozprzestrzenianiem wiadomości o charakterze deepfake” prowadzone są w ramach I konkursu „Infostrateg” Narodowego Centrum Badań i Rozwoju.

Zespół naukowców z Politechniki Krakowskiej (dr hab. inż. Michał Bereta, prof. PK, dr inż. Paweł Jarosz, dr Adam Marszałek, wspierani przez dr. hab. Pawła Karczmarka, prof. Politechniki Lubelskiej) otrzymał na nie dofinansowanie w wysokości blisko 4 mln zł.